●■●

令人头疼的基础运算练习题,是我们小学时代记忆中非常生动的一部分。在做3752×6901这样的乘法运算时,我们只能借助纸笔的帮助,可能要花上一分钟的时间才能算出结果。诚然,如今我们都会随身携带手机,所以我们能够快速地查出这道小练习题的结果是25892552。事实上,现代手机中的处理器每秒能够进行1000亿次此类操作。此外,相关的芯片只耗费几瓦的功率;而人类大脑要耗费大约20瓦的功率,需要的时间也远远多于芯片。由此看来,对于这样的运算,芯片的效率远远高于我们的大脑。●当然,大脑进化的目的并不在于算数,所以大脑算数方面的能力比较差。然而,大脑却擅长处理周围环境中连续的信息流,并对信息做出反应——有时候我们甚至意识不到它到底有多快。无论一台传统计算机耗费多少能量,对于我们的大脑轻易就可以完成的事情,例如理解语言、跑上一段楼梯等,它们完成起来都非常困难。

如果我们能够研发出既具备计算能力,又拥有大脑那般能源效率的机器,那么,这台机器就会成为游戏规则的改变者;届时,机器人将能够在物理世界中娴熟地移动、用通俗易懂的语言和我们交流。各个大型的系统将能够从商业、科学、医学领域或政府部门获取大量数据,来检测全新的模式、发现因果关系,或是进行相关的预测。智能移动应用,如Siri和微软小娜,对云技术的依赖将会降低;同样的技术,还可以应用到那些低功耗设备,用于维持我们的感官、运送药物、模仿神经信号,以此来弥补器官损伤或瘫痪。

但是,现在就进行如此大胆的尝试,是不是还为时过早?要根据大脑运转规律开始研发相关的技术,我们手中掌握的大脑知识是不是太有限了?我相信,即便只能模拟出神经回路的一些基本特性,也依然可以为许多相关商业应用带来举世瞩目的进步。为了达到大脑的性能水平,计算机应在多大程度上模拟生物细节?这依然是一个没有确切答案的问题。但是今天的脑启发或神经形态系统对于回答这个问题而言,将是非常重要的研究工具。

●■●

用于储存数据和指令的存储器和用于处理此类信息的逻辑之间存在着物理分离,这是传统计算机的一个关键特征。而人类大脑中却不存在这种差异。在一个由大约1000亿个神经细胞(神经元)以及超过100万亿个连接点(突触)组成的庞大网络中,计算与数据存储可以共同在本地完成。这些连接点以及每个神经元对输入的反应方式,决定了大脑的大部分行为。

当我们论及人类大脑所具备的那些超凡能力时,通常所指的是在长期的进化过程中最新增加的部分:新皮质。这一层薄薄的、高度折叠的皮质形成了我们大脑的外壳层,可以执行多种多样的任务,包括感觉输入处理、运动控制、记忆以及学习。这些范围很广的能力可以通过一个较为统一的结构来完成:由神经元组成的6个水平层以及100万个500微米宽的竖列。以此集成相关的电码信息,并沿着那些从神经元中延伸出来的卷须状物——树突与轴突——来分配这些信息。

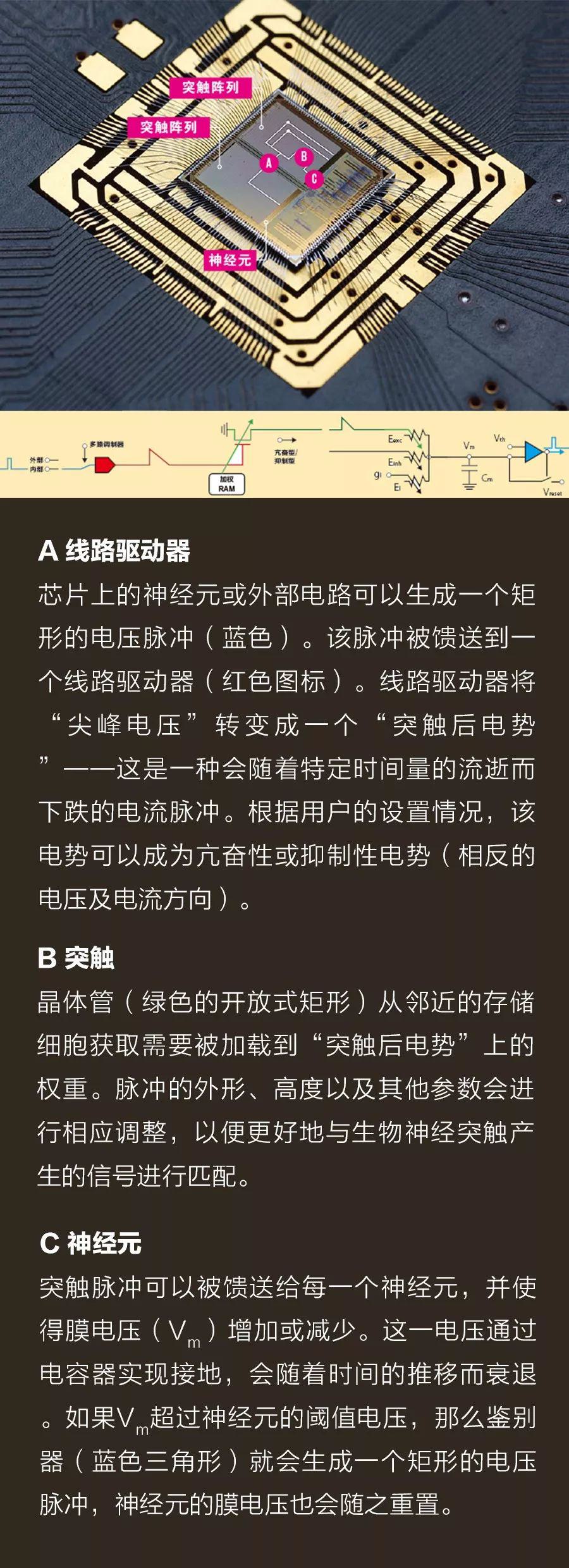

与所有的人体细胞相似,一般情况下,一个神经元内部与外部之间的电压约为-70毫伏。当神经元接收到与之相连的其他神经元发出的信号时,这一膜电压也会相应地发生变化。当该膜电压升到一个临界阈限时,就会生成电压脉冲,或是尖峰,持续时间为若干毫秒,电压值约为40毫伏。电压脉冲会沿着神经元的轴突进行传导,直至到达突触。突触是一种复杂的生物结构,能够将一个神经元的轴突连接到另一个神经元的树突上。如果这种尖峰达到一定的条件,那么突触就会将其转化为另一个电压脉冲。电压脉冲会沿着接收神经元的分支树突结构传导,然后让其细胞膜电压产生或正或负的变化。

连通性是大脑的一个重要特性。如锥体细胞——人类新皮质中一种尤为重要的细胞——容纳了约3万个突触,可以接收其他神经元发来的约3万个输入信号。大脑一直在不停地进行自适应调整。由于受到感觉输入以及外部环境反馈的驱动,神经元和突触的特征——甚至是网络结构本身——总处于不断变化中。

目前,通用型计算机更倾向于数字化操作,而非模拟操作;但对大脑进行归类却不是那么容易。神经元可以积累电荷,就像电子电路中的电容器那样。很明显,积累过程就是一个模拟过程。但大脑也同样可以使用尖峰作为信息单位,且基本上都是二进制的:在任一位置和时间,要么出现尖峰,要么不出现尖峰。从电子学角度来看,大脑其实就是一个混合信号系统,具有本地模拟计算以及二进制尖峰电压通信能力。模拟与数字技术混合,可帮助大脑克服传输损耗的缺陷。尖峰电压从本质来说,都有一个值(0或1),可以在不丢失基本信息的情况下,传输很长一段距离;此外,该电压脉冲达到网络中下一个神经元时还可以再生。

大脑与计算机之间的另一个关键差异在于,大脑在同步所有信息时无需中枢生物钟的参与。虽然我们能观察到同步事件——脑电波,但这些事件都是神经网络的自发产物。有趣的是,现代计算已经开始运用类脑异步性,通过进行并行操作来加快计算的速度。但是,大脑和计算机这两个系统中并行的水平与用途却截然不同。

●■●

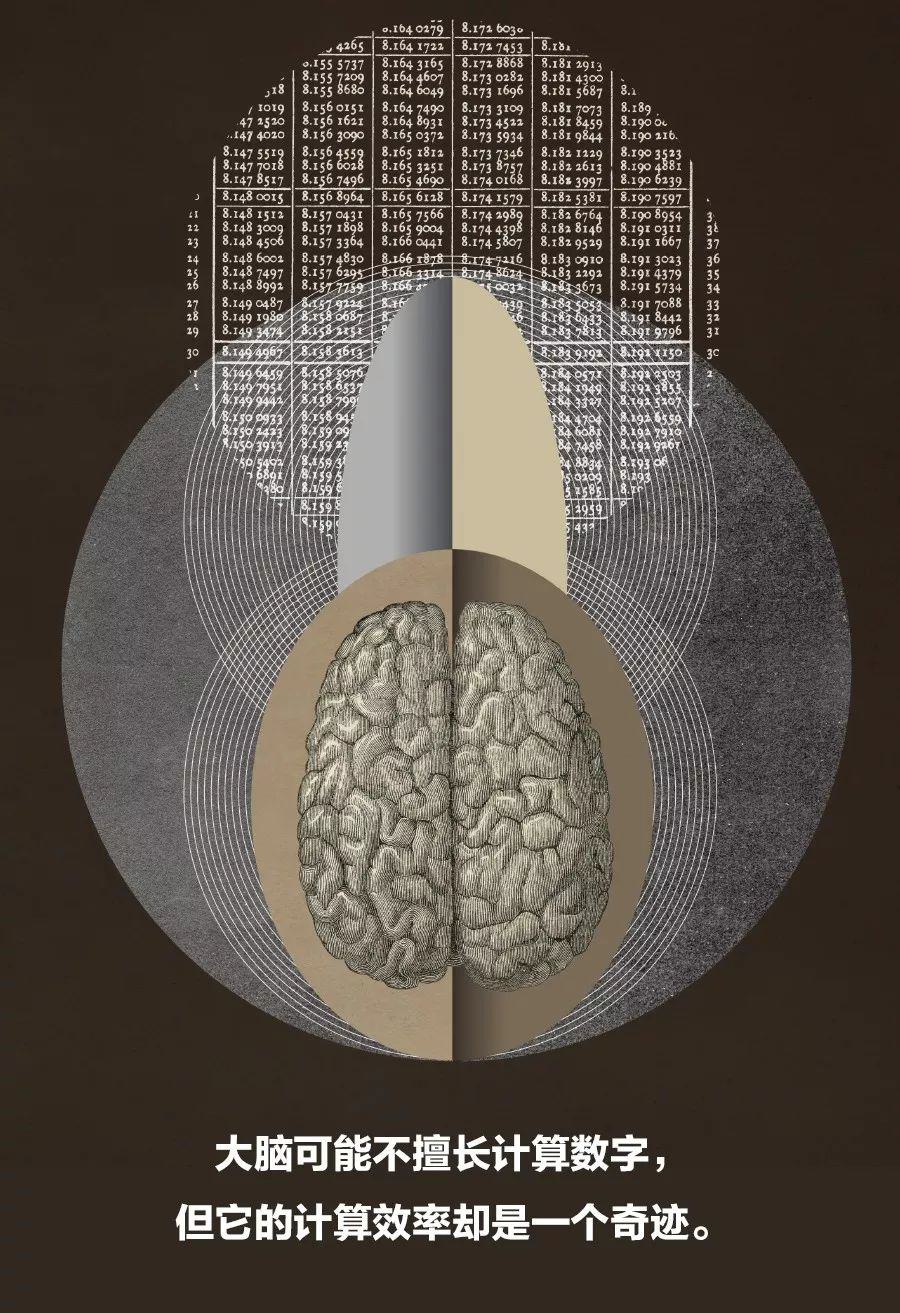

把大脑构造作为计算模型来运用,这一理念有着深厚的根基。在早期的尝试中,人们的注意力主要集中在简单的阈值神经元上:如若权重输入的总和超过阈值,就会输出一个数值;如总和在阈值以下,就会输出另一个数值。在沃伦•麦卡洛克(Warren McCulloch)和沃尔特•皮兹(Walter Pitts)20世纪40年代提出的方案中,虽然生物实在论方面的论据有限,但它却是人类向采用放电神经元概念作为计算元件所迈出的第一步。

1957年,弗兰克•罗森布拉特(Frank Rosenblatt)提出了一种后来被称为“感知机”(perceptron)的阈值神经元变异体。一个集成众多节点(人工神经元)的网络被分为若干层;位于网络边缘处的“可见”层可充当输入或输出的角色,与外部世界进行互动。而那些用于执行大批量计算的“隐藏”层,则位于输入与输出层的中间。

同时,罗森布拉特还介绍了在大脑中发现的一个本质特征:抑制性。感知机网络中的神经元,除了能够将所有的输入信息集成在一起以外,还可以造成负贡献。这一特征使得神经网络仅通过一个隐藏层,便可以解决逻辑中的异或问题;在这种逻辑下,只有在两个二进制输入不同时(只有一个输入为真),输出才为真。这个简单的例子表明,利用生物实在论可以带来新的计算能力。然而,对于大脑的功能来说,哪种特征才具有本质意义呢?哪些又是无用的进化痕迹呢?答案无人知晓。

的确,我们知道有些傲人的计算成就可以在不过多依赖生物实在论的前提下完成。比如,深度学习领域的研究人员在使用计算机从复杂的图片上分析大批量数据和找出特征方面已经取得了重大进展。虽然他们构建的神经网络与之前相比具备了更多的输入信号与隐藏层,但这些网络的基础仍然是简单的神经元模型。这些强大的能力反映出的并不是生物实在论,而是它们所容纳的网络规模,以及用来训练它们的强大的计算机。在计算性能、能量效率以及学习能力方面,深度学习网络与生物大脑仍然相距甚远。

当对大脑进行大规模模拟时,再次凸显了大脑与当今计算机之间的巨大鸿沟。多年来,人们为了跨越这一鸿沟进行了多次努力,但所有的工作都受到了两种因素的严重限制:能量与模拟时间。例如,马库斯•帝斯曼(Markus Diesmann)及其同事在几年前为了完成相关的模拟,在日本的超级计算机“京”上使用了约8.3万个处理器。尽管使用的是高度简化的模型,也没有进行任何学习活动,模拟17.3亿个神经元所消耗的能量却是同等规模的大脑耗能的100亿倍。且总的来说,这些模拟的实时运行速度还不足生物大脑运行速度的千分之一。

那么,速度为什么会这么慢呢?原因在于如果在传统计算机上模拟大脑,则需要数十亿个耦合在一起的微分方程,来描述细胞和网络的动态情况。模拟过程有很多,例如电荷穿过一个细胞膜的运动。如果计算机运用布尔逻辑(该逻辑中精准度的达成以牺牲能量为代价)并将存储和计算相互分离,在真实模拟大脑时,效率就会很低。

计算机模拟可以成为协助我们理解大脑的一种工具。我们可以将实验室知识进行传输,运用在那些我们可以进行试验并和真实世界的观察情况进行对比的模拟中。但如果我们想要反其道而行之,运用神经系统科学方面的相关经验来打造全新的、强大的计算系统的话,那么我们应反思计算机的设计与制造方式。

实际上,在电子设备中复制大脑的运转方式,可能远比第一眼看上去更可行。因为在一个突触中构建一个电势所消耗的能量大约是10毫微微焦耳(10-15焦耳)。金属氧化物半导体(MOS)晶体管上的栅极远比那些最先进CPU所使用的大得多,能耗也更高;最先进CPU的栅极只需要0.5毫微微焦耳就能进行充电。因此,一个突触传导就等同于向(至少)20个晶体管进行充电。此外,在设备层面上,生物电路与电子电路并没有太大差异。从原理上来说,我们应该可以用晶体管构建出与突触和神经元类似的结构,然后将其接通,实现一个不会消耗惊人能量的人工大脑。

●■●

让晶体管模仿神经元来打造计算机的概念起源于20世纪80年代加州理工学院卡福•米德(Carver Mead)教授的研究工作。当以特定模式进行操作时,半导体器件可以遵循与神经元相同的规则,这就可以在保证高水平能量效率的前提下进行相关计算。这便是后来被米德命名为“神经形态”计算概念的核心论点之一。

米德的团队也发明了一种神经通信框架,在此框架中,尖峰电压仅被按照其网络地址和出现的时间来编码。这是一项开创性的工作,因为这是第一次让时间因素成为人工神经网络的基本特征。时间在大脑中是一个关键因素:各种信号要花时间进行传播、各个神经膜也要花时间对不断变化的情况做出响应。并且,时间决定了突触后电势的成型情况。

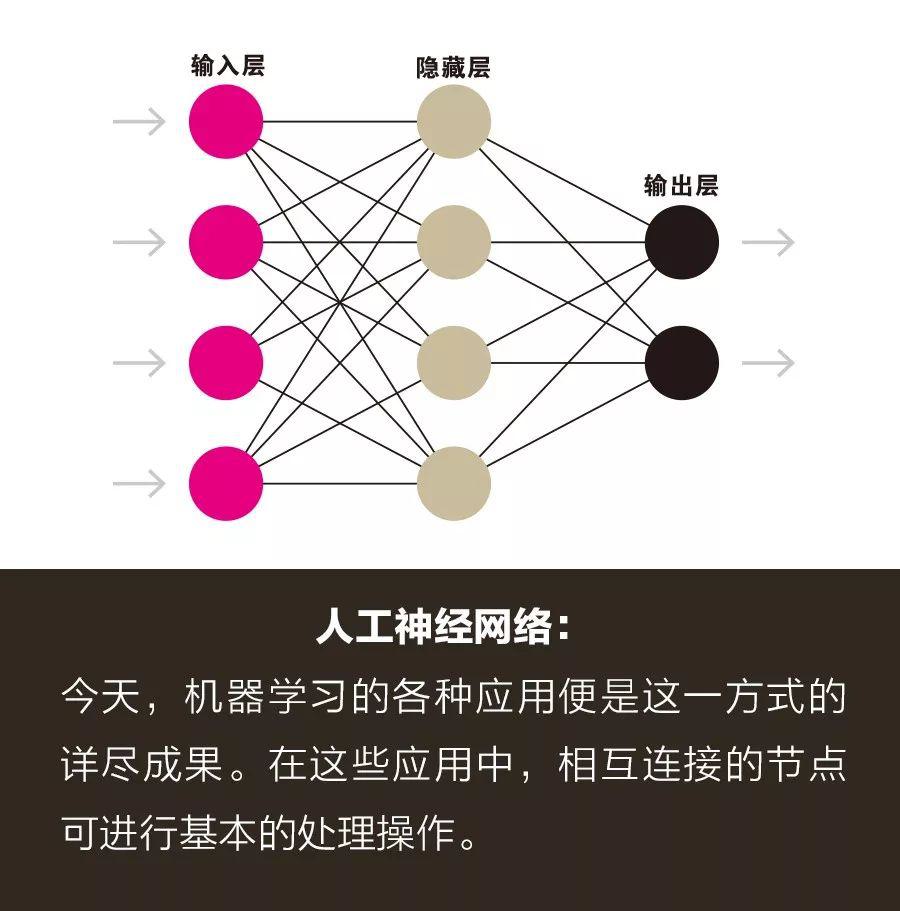

硅神经元

从上图中早期的原型芯片中演化出来的大脑规模的设计被称为“Spikey”。芯片共有4个主要元件——神经元,用于集成多个突触发出的信号,并在电压超过阈值时放电;线路驱动器,协助调和神经元发出的信号,并将这些信号输送至突触;密集的突触阵列,能够对这些信号进行加权,具备“可塑性”,可根据时间的长短发生变化;数字电路,用于连接外部世界,传递芯片配置或数据等相关信息。神经元之间的连接可以在外部进行设置,也可以根据可塑性机理从内部演化而来。

如今,一些相当活跃的研究团队,如苏黎世联邦理工大学的贾科莫•因迪韦里(Giacomo Indiveri)的研究团队、斯坦福大学夸贝纳•波尔汉(KwabenaBoahen)的研究团队,已经按照米德提出的方法,成功制作出了生物皮质网络中的若干个元件。他们采用的方法是使用极低的电流来操作那些处于通电阈值以下的晶体管;以此构建出那些能耗低并能模拟神经行为的模拟电路。

对该方向进行进一步研究,或许可以实现脑机接口等系统的应用。但要研发出具备完整动物大脑能力(如网络规模、连通性和学习能力)的电路,还需一个巨大的飞跃。

因而,在2005年左右,3个研究团队分别开始独立研究神经形态系统。他们的研究与米德的初始方案相差甚远,旨在研发出含有数百万个神经元的大型系统。

由英国曼彻斯特大学史蒂夫•费伯(Steve Furber)领导的大三角帆(SpiNNaker)项目,是最接近传统计算的项目。该团队已设计出了一种特制的、全数字化的芯片。该芯片包含18个ARM微处理器内核,时钟速度为200兆赫——约为现代CPU运行速度的1/10。虽然ARM内核是传统计算机,但是它们能够模拟尖峰。这些尖峰会通过一个专门设计的路由器进行传送,实现与大脑相同的异步通信。目前的一项方案(欧盟人脑工程项目的一部分)已于2016年完成,其中共有50万个ARM内核。根据神经元模型的复杂程度,每个内核可以模拟多达1000个神经元。

由加州IBM阿尔马登研究实验室的蒙德拉•莫达(Dharmendra Modha)及其同事开发的TrueNorth芯片,放弃了将微处理器作为计算装置。芯片上计算与存储相互交错,是一个真正意义上的神经形态计算系统TrueNorth芯片依然是一个全数字系统,但依靠特制的神经元电路来实现指定的神经元模型。同时,通过利用28纳米的三星互补金属氧化物半导体(CMOS)技术,该芯片配置了54亿个晶体管。这些晶体管在一个单芯片上,用于实现100万个神经元电路和2.56亿个简单(1比特)突触。

我认为,BrainScaleS是最偏离传统计算,而与生物大脑最为接近的一个系统。该系统是我和同事在德国海德堡大学为人脑工程而开发的。BrainScaleS是一个混合信号系统,通过数字通信,将那些由硅晶体管制造的神经元和突触(模拟器件)结合在一起。这一全尺寸系统由20个未经切割的8英寸硅片构造而成,旨在创造出400万个神经元、10亿个突触。

通过与神经系统科学家的密切协作,我们的系统能够复制8种不同的生物神经元放电模式。与米德开创的模拟方法不同,BrainScaleS在一个加速模式中运作,运行速度是实时速度的约1万倍。如此一来,该系统特别适合学习与研发方面的任务。

在未来,学习能力可能会成为神经形态系统发展过程中的重要组成部分。到那时,脑启发的芯片,以及在传统计算机上实施的神经网络,可以通过更加强大的计算机进行训练。但如果我们想在现实世界中运用神经形态系统(比如用于支持那些与我们一起工作的机器人),那么这些系统必须在现实的运行中实现学习与自适应。

通过在芯片上构建“可塑性处理器”,我和同事将学习能力赋予了第二代BrainScaleS系统。而可塑性处理器在必要时,可用来修改神经元和突触参数。同样,这一修改能力让我们能够对相关参数进行微调,弥补不同设备之间尺寸和电学性能方面的差异,就像大脑可以随机应变一样。

我在前文描述的那3种大型系统的特点是互补的。SpiNNaker的可配置性水平最高,因此可以用来检测各种不同的神经元模型;TrueNorth具有很高的集成密度;BrainScaleS则是为了执行学习与发展的连续运算而设计。因此,找到正确的方法来评价此类系统的性能,需要进行不断的努力。但早期的研究结果暗示了未来的前景。比如IBM的TrueNorth团队最近就估计,在其研发的系统中,一次突触传导将消耗26微微焦耳的能量。虽然这些能量约是生物系统中同一操作所耗能量的1000倍,但却是一台传统的通用型计算机进行模拟时所消耗能量的十万分之一左右。

我们在理解这些系统能够做什么,以及如何将其运用到现实世界的应用中等方面,仍旧处于初始阶段。我们必须找到合适的方法,在降低能耗的同时,将诸多的神经形态芯片集成到那些具备增强型学习能力的更大网络中。连通性便是挑战之一:大脑是三维的,但我们搭建的电路是二维的。电路的三维集成,是人们正积极探索的一个领域,可以帮助解决这一问题。

另一个推动因素是非CMOS装置,如忆阻器或相变型随机存取存储器(RAM)。目前,管控人工突触对输入信号做出何种反应的权重值,被储存在传统的数字存储器中;而这些存储器占据了构建网络中需要的硅资源。其他形式的存储器能够帮助我们将细胞的尺寸从微米级降到纳米级。随着系统发展到今天的水平,我们面对的一个挑战便是如何解决单个设备之间存在的差异。届时,BrainScaleS创设的校准策略或许能派上用场。

虽然在研发可用且有用的神经形态系统方面,我们才刚刚扬帆起航,但所有的努力都是值得的。如果取得成功,我们将不仅能够搭建强大的计算系统,甚至可以洞察自己大脑中的情况。

作者: Karlheinz Meier

往期推荐